Nur rund 20 % der Unternehmen nutzen derzeit KI in HR oder Payroll – und das sind fast ausschließlich Großunternehmen. Im Mittelstand? Kaum mehr als 5 %.

Dabei steckt in KI enormes Potenzial: Von smarter Dokumentenverarbeitung über Textautomatisierung bis hin zu datengetriebener Entscheidungsunterstützung. Doch viele Unternehmen trauen sich nicht – oder dürfen nicht.

Der Grund? Datenschutz. Oder besser gesagt: Angst vor Datenschutzverstößen.

Ein echter Satz meinem Trainer-Alltag:

„Wir hatten jetzt unsere allgemeine KI-Schulung nach EU AI Act. Ihr Webinar war ehrlich gesagt viel besser. Da ging es endlich mal um die Anwendung. Bei uns nur Datenschutz, Datenschutz. Jetzt darf ich ChatGPT und Perplexity nicht mehr nutzen. Nur noch Co-Pilot, und der ist langweilig.“

Diese Rückmeldung kam von einer Kundin, die mein KI-Webinar für Azubis gebucht hat – Auftraggeberin und Teilnehmerin zugleich. Ihr Frust ist kein Einzelfall.

Und ganz ehrlich: Ich persönlich bin kein Fan von Co-Pilot. Für viele praktische Anwendungen, gerade im HR- und Payrollkontext, bietet er mir zu wenig Nutzwert und zu viel technisches Framework. KI muss sich an der echten Arbeit orientieren – nicht an starren Tools.

Aber: Wie soll man KI verstehen, wenn man sie nicht anwenden darf?

In meinem Webinar für Auszubildende wurde genau das deutlich.

Ein Azubi-Teilnehmer sagte:

„Ich lerne am besten, wenn ich es direkt in der Praxis anwenden kann.“

Und genau das ist der Punkt. KI lernt man nicht durch Richtlinien, sondern durchs Machen, durch das Erleben von Grenzen und Chancen, durch offenen Dialog.

Datenschutz muss sein. Aber er darf nicht zum Innovationsstopper werden.

Hier ein paar konkrete Ansätze, wie Unternehmen KI datenschutzkonform und gleichzeitig sinnvoll einsetzen können:

1. Klare Trennung zwischen öffentlichen Tools (z. B. ChatGPT, Gemini, Perplexity) und internen Daten: Keine personenbezogenen oder geschäftskritischen Infos eingeben.

2. Unternehmenslizenzen nutzen, z. B. ChatGPT Enterprise, Microsoft Copilot mit EU-Compliance oder eigene LLMs auf sicherer Infrastruktur.

3. Interne KI-Richtlinien erstellen: Wer darf was nutzen? Welche Tools sind erlaubt? Was darf rein, was nicht?

4. Praxisnahe Schulungen statt Frontal-Verbote: Mitarbeitende brauchen Anwendungskompetenz, nicht nur Risiken. (Genau das mache ich in meinen Seminaren!)

5. Pilot-Use-Cases statt Panik: Lieber kleinschrittig starten als mit generellen Sperren.

6. Cloud-Lösungen gezielt konfigurieren:

– KI-Modelle nur in EU-Rechenzentren hosten (z. B. Azure OpenAI EU-Region)

– Zugriffsrechte und Datenflüsse klar dokumentieren

– Zero Trust und Verschlüsselung implementieren, um sensible Informationen zu schützen

– Nur autorisierte Accounts für KI-Dienste freigeben – kein Wildwuchs an Plug-ins und Add-ons

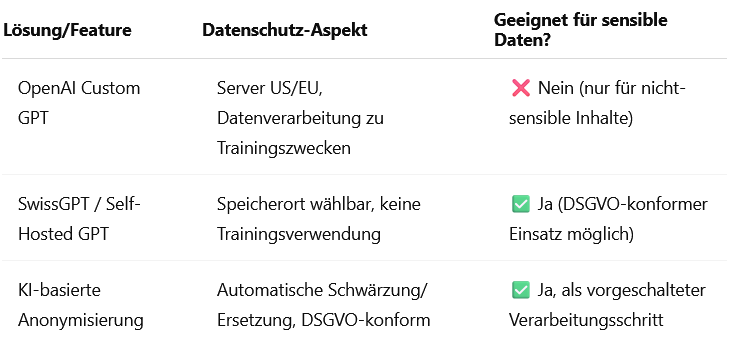

7. Achtung: Custom GPTs verantwortungsvoll einsetzen:

Bei der Nutzung von Custom GPTs – etwa auf Basis von OpenAI – gelten dieselben Regeln wie bei ChatGPT: Eingaben werden zentral verarbeitet und können zu Trainingszwecken genutzt werden, sofern dies nicht deaktiviert wird.

Besonders sensible oder personenbezogene HR-/Payroll-Daten gehören nicht in öffentliche oder frei zugängliche GPTs.

Unternehmen sollten auf DSGVO-konforme Hostingmodelle setzen – z. B. SwissGPT (Server in der Schweiz, keine Datenweitergabe) oder Self-hosted GPTs auf interner Infrastruktur.

💡 SwissGPT eignet sich besonders für HR-Teams, Datenschutzverantwortliche oder Organisationen mit hoher regulatorischer Verantwortung – etwa im Gesundheits-, Sozial- oder Finanzwesen.

Ideal ist die Kombination aus Custom GPTs mit vorgeschalteter Anonymisierung: sensible Inhalte werden automatisiert unkenntlich gemacht, bevor sie verarbeitet werden. Rückführung ist nur über geschützte Schlüssel möglich.

Empfehlungen zusammengefasst:

________________________________________________________________________________________________________________________

Mein Fazit:

Wie bei vielem im Leben liegt die Lösung in der Mitte: Anwendung und Datenschutz müssen Hand in Hand gehen.

KI-Tools einfach zu sperren? Keine Lösung.

Unternehmen machen es sich hier selbst schwer. Der bessere Weg: klar regulieren, gut schulen – und fachspezifisch anwenden.

Der Mittelstand darf beim Thema KI nicht abgehängt werden – aber genau das passiert gerade. Datenschutz ist wichtig – aber nicht, wenn er echte Innovation verhindert.

Wer nicht mit KI lernt, wird – und zwar bald – von denen abgehängt, die es tun.

Die Entwicklung ist rasant.

________________________________________________________________________________________________________________________

Unterstützung bei Ihrer Digitalisierung im HR- und Payroll-Bereich erwünscht? oder Interesse an meinen KI-Webinaren für Payroll und HR?

👉 Kontaktieren Sie mich – ich freue mich auf Ihre Nachricht!